生成AIと検索技術の進化により、FAQは「文書の置き場」から「会話で解決する業務インフラ」へと変わりました。社内ヘルプデスクや人事・総務の問い合わせ、営業やカスタマーサポートのナレッジ共有まで、AI活用のFAQは自己解決率を高め、担当者の負荷を大幅に削減します。

本記事は、IT担当や導入検討の責任者に向け、AI活用のFAQの全体像、従来型との違い、6週間で進める導入ステップ、選定判断基準、ガバナンスと運用の注意点を具体的に示します。小規模なパイロットから安全に始め、短期間で実効性を確認するための実務ノウハウを凝縮しました。

現場が自然言語で質問し、根拠付きの回答が即座に返ることは、問い合わせの待ち時間を解消し、意思決定を加速します。リスクを制御しながら効果を最大化するための設計・運用ポイントを、チェックリストと手順で解説します。

AI活用のFAQとは:しくみと主要ユースケース

AI活用のFAQは、社内外の文書やナレッジベースから必要情報を検索し、生成AIが自然言語で回答を組み立てる仕組み(RAG:Retrieval-Augmented Generation)を中核とします。TeamsやSlack、社内ポータルと連携し、ユーザーは会話形式で解決できます。回答には参照元リンクや根拠を付与し、権限に応じて閲覧可否を自動制御します。更新は既存のドキュメント管理(SharePoint、Confluenceなど)と同期し、手間なく鮮度を維持します。

- 社内ヘルプデスク:アカウント、VPN、ソフト配布、PCトラブルの一次解決を自動化。解決率向上とチケット削減を両立。

- 人事・総務:就業規則、各種申請、福利厚生の問い合せを自己解決化。手続きの手順や様式の最新版を提示。

- 営業・CS:製品仕様、価格、提案トーク、過去事例を横断検索。根拠リンク付き回答で即時に顧客対応。

- 開発・品質:設計書、API仕様、トラブルシュート手順を統合。再発防止ナレッジを蓄積・再利用。

- 法務・コンプラ:ルールや契約雛形への誘導、改訂差分の要約。誤用防止のためのガードレールと承認フローを適用。

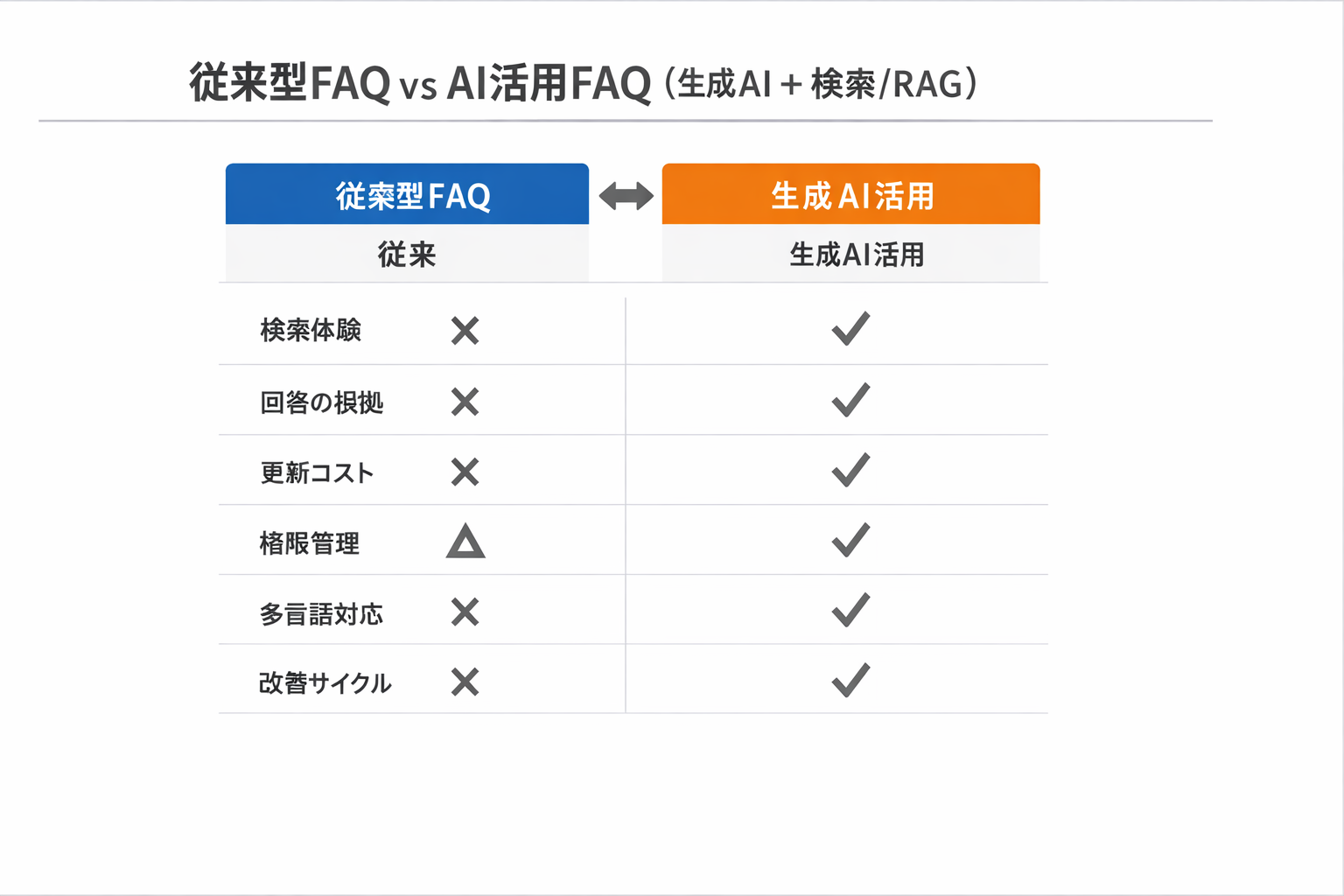

従来型FAQとAI活用FAQの比較:何がどれだけ変わるか

- 検索体験:従来はキーワード一致と手動探索。AIは自然文で要点抽出・追質問対応・要約で到達時間を短縮。

- 回答根拠:従来はリンク提示のみ。AIは引用と出典リンクを自動付与し、信頼性を可視化。

- 更新運用:従来は静的ページの手作業更新。AIはソース同期と差分検出で更新負荷を削減。

- 権限制御:従来はページ単位。AIはドキュメント権限を継承し、回答時に段落レベルで制御可能。

- 多言語:従来は別ページ維持が必要。AIは質問・回答を自動翻訳し、単一ソースで多言語対応。

- 改善指標:従来はPV中心。AIは解決率、エスカレーション率、幻覚率、参照カバレッジを定量管理。

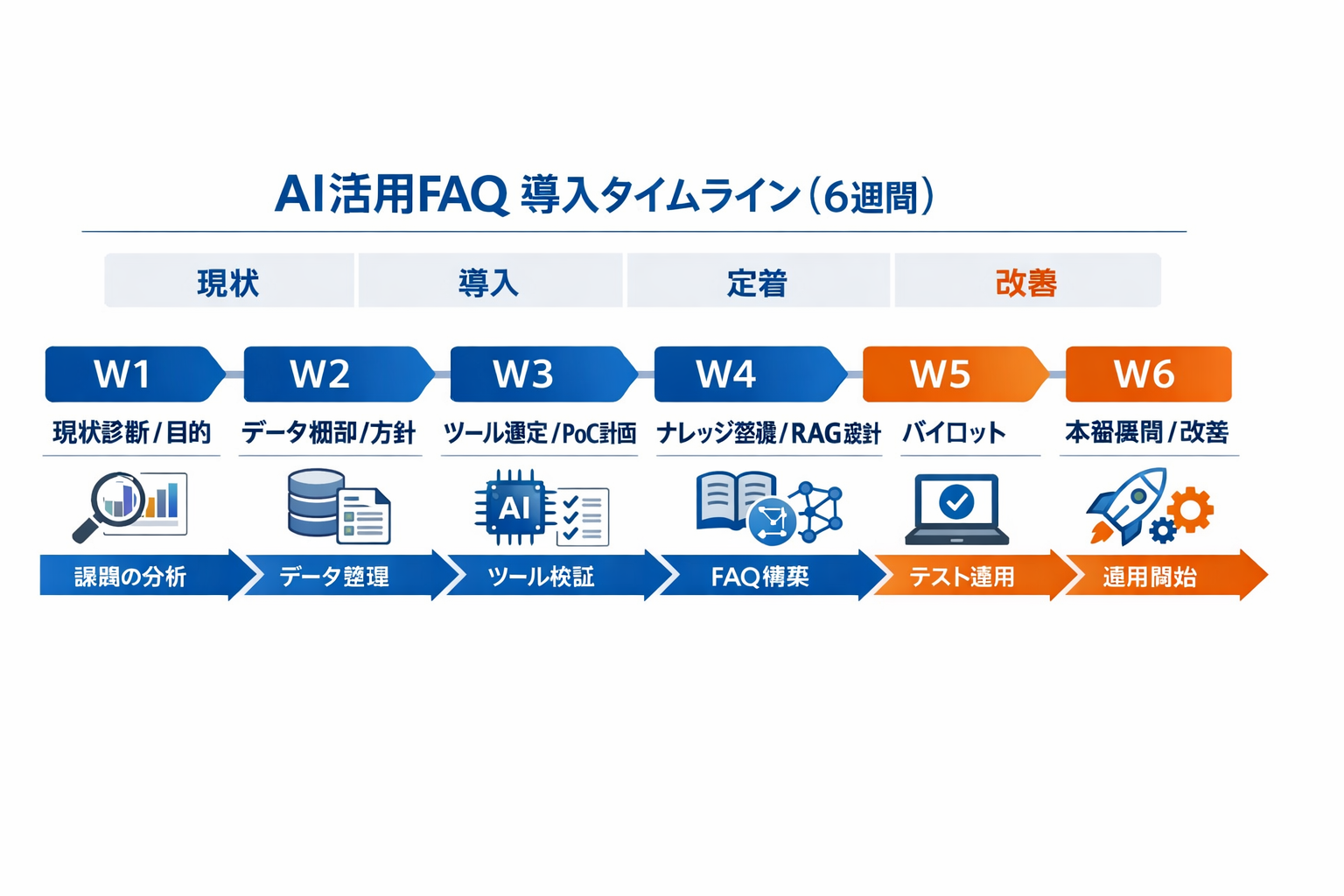

6週間で進める導入ステップ:小さく始めて確実に成果を出す

- 現状診断と目的設定(W1):過去3〜6カ月の問い合わせ上位100件を分類し、自己解決率・平均応答時間・エスカレーション率を基準化。対象範囲(例:ITヘルプデスクと人事FAQ)と成功指標(自己解決率+20pt、初回応答<2秒など)を合意。関係者(IT、業務部門、法務/情報セキュリティ)を特定。

- データ棚卸とガバナンス方針(W2):参照元(SharePoint、Confluence、ファイルサーバー、チケットシステム)を棚卸し、機密区分・アクセス権・個人情報の有無を明記。編集責任者をドキュメント単位で割当。マスキング方針、保管場所、利用許可範囲、監査ログ要件を定義。

- ツール選定とPoC設計(W3):候補3製品をショートリスト化。評価セット(200問程度)を作成し、根拠提示率、正答率、幻覚率、応答時間、権限連携、Teams/Slack連携を比較。成功基準を数値で設定(例:根拠提示率90%以上、正答率80%以上)。

- ナレッジ整備とRAG設計(W4):重複や陳腐化を整理。文書を段落/セクションに分割し、メタデータ(部門、機密区分、更新日、版)を付与。プロンプトに『引用必須・不明時は謝罪』を組み込み、禁止応答リストと許容リスクを設定。

- パイロット運用と教育(W5):50〜100名のテストユーザーで運用。利用トレーニングを実施し、週次で未解決トップ10を改善。ABテストでプロンプト/回答テンプレートを比較。エスカレーション連携(ServiceNow/Jira等)を検証。

- 本番展開・定着化(W6):SSO/SCIMを有効化し権限を本番同期。運用Runbook、バックアップ、モデル更新手順、障害時連絡網を整備。ダッシュボードでKPIを可視化し、月次改善会議を定例化。

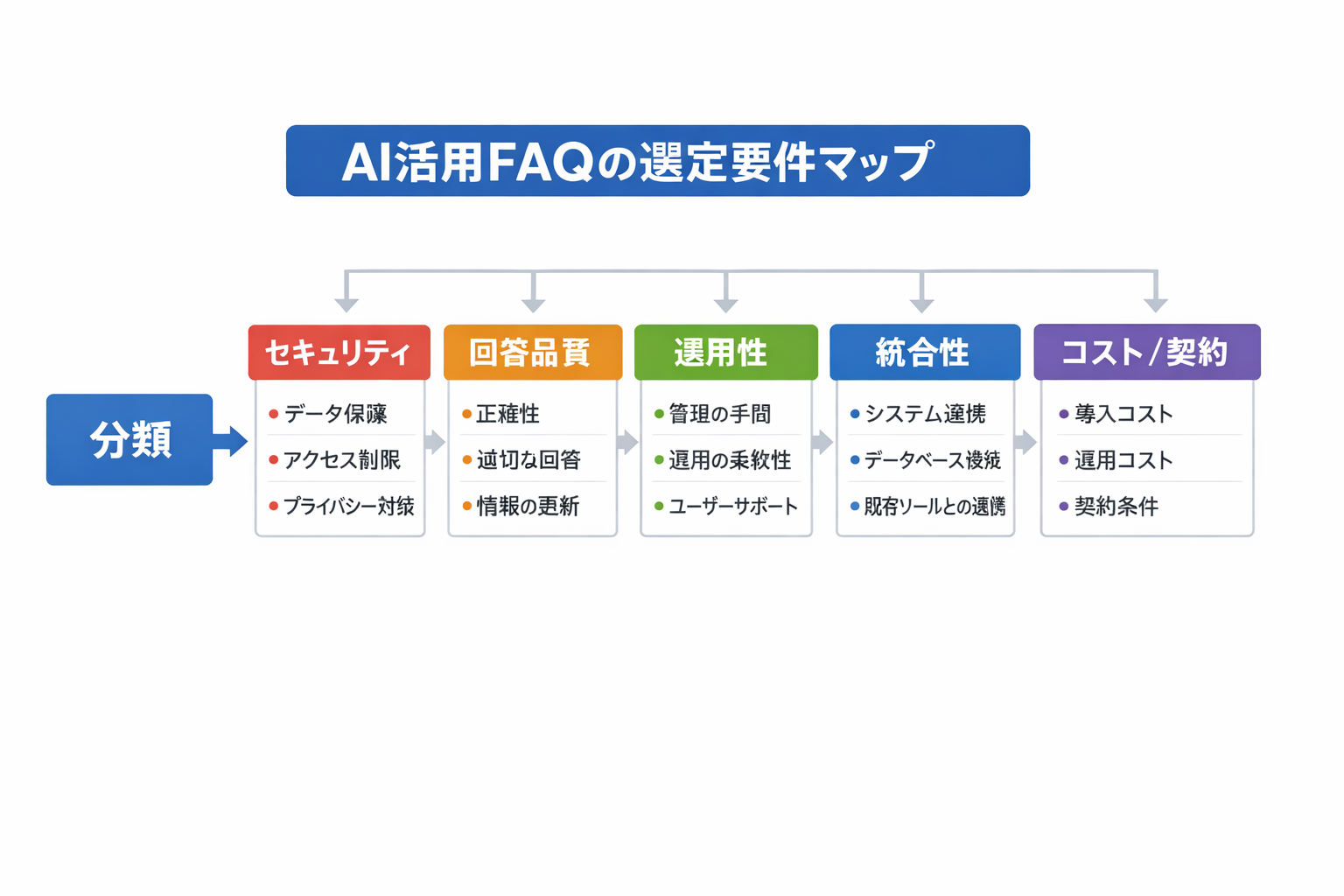

選定判断基準とRFPチェックリスト:品質・運用・セキュリティを両立

- セキュリティ:SSO/SAML/OIDC、SCIMプロビジョニング、データ所在(国内/選択可)、テナント分離、暗号化(保存/転送)、監査ログ。RFPでは『日本リージョン選択可』『テナント内学習オフ設定可』を明記。

- 回答品質:RAGの精度(BM25+ベクトル併用可否)、引用必須設定、回答の温度管理、評価用ベンチマーク運用。『根拠リンク提示率』『幻覚率』『応答時間P95』を数値SLA化。

- 運用性:編集者UI、変更履歴・承認ワークフロー、差分検知アラート、ABテスト、ロール権限。『更新から反映までの最大遅延(例:15分以内)』を要件化。

- 統合性:Teams/Slackのネイティブ連携、SharePoint/Confluence/Google Drive接続、チケット連携(ServiceNow/Jira)、Webhook/APIの拡張。PoCで実接続を検証。

- コスト/契約:ユーザー/MAU/問い合わせ課金の違い、推論コスト(トークン/リクエスト)、含まれるサポート範囲、解約/データ持ち帰り条件。3年総保有コストを試算。

- サポート:日本語SLA、導入伴走、ナレッジ作成支援、モデル更新通知。『重大障害の初動30分以内』などのSLAを確認。

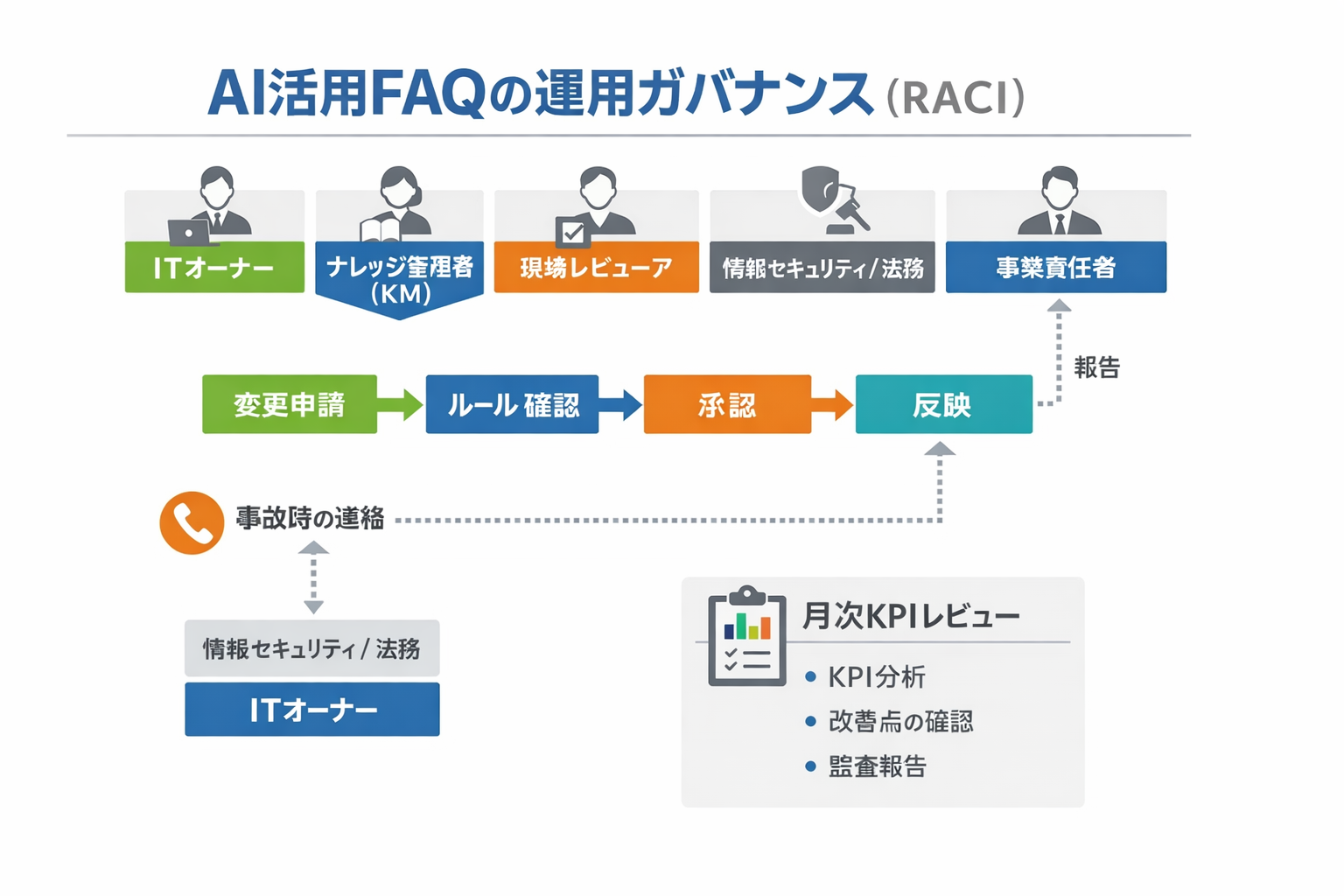

運用体制・ガバナンスとKPI:責任分解と改善サイクル

- 役割分担:ITオーナー(最終責任/運用SLA)、KM(コンテンツ品質/更新承認)、現場レビューア(実務妥当性)、情シス/法務(権限/法令順守)、事業責任者(優先度/投資判断)。RACIを文書化。

- 変更管理:変更申請→レビュー→承認→反映をワークフロー化。重大変更はステージングで検証し、ロールバック手順を定義。週次の差分レビューを定例化。

- KPI設計:主要KPI:自己解決率、エスカレーション率、回答の根拠提示率、幻覚率(<1%目標)、応答時間P95(<2秒)、ユーザー満足度。月次で改善施策とセットでレビュー。

- ログ活用:未解決トップ10、誤回答サンプル、離脱セッションを毎週抽出。新規Qの増加領域を特定し、FAQ拡充をスプリントに組み込む。

- 教育・定着:新人オンボーディングに利用方法を組込み、プロンプトの良い例/悪い例を配布。現場リーダーが成功事例を共有し、利用促進を継続。

失敗を防ぐ注意点とアンチパターン

- データ未整備:古い文書や重複が多いと誤回答が増加。初期に上位20文書から整備し、更新日と版を明記。

- 過信と無監視:『常に正しい』前提は危険。引用必須、信頼度スコア閾値、不明時のフォールバック(人に繋ぐ)を設定。

- 検証不足:PoCで実データを使わないと本番で破綻。代表200問の評価セットと合格基準を事前に合意。

- 導入の拡散:部門ごとに別ツール導入はサイロ化を招く。共通基盤+部門拡張の二層アーキテクチャで統一。

- 権限の穴:閲覧不可データの漏えいは致命傷。SSO/SCIM連携、権限継承テスト、退職者アカウントの即時失効を徹底。

- 学習の停滞:運用後の改善が止まると効果が頭打ち。週次の未解決レビューと月次のKPI会議をルーティン化。

AI活用のFAQは、問い合わせ対応のボトルネックを解消し、現場の意思決定を加速する実用的な土台です。従来型と比べ、検索体験・回答品質・運用効率が段違いに向上し、自己解決率の改善が直接的なコスト削減と顧客/従業員体験の向上につながります。

一方で、品質・セキュリティ・運用の三位一体で設計しなければ、誤回答や情報漏えいのリスクが残ります。6週間の導入ステップ、明確な判断基準、ガバナンス体制、KPIレビューをセットで実施することで、小さく始めて確実に成果を積み上げられます。

まずは上位100件の問い合わせを起点にパイロットを設計し、引用必須と権限制御を有効化した最小構成で検証しましょう。短いサイクルで改善を回せば、AI時代の新しい働き方が現実の業務成果として定着します。