AI活用は「何を使うか」より「何に使うか」で成果が決まります。本記事は、主要AIツールの全体像と比較軸、現場で機能する導入ステップ、よくある失敗と対策までを一気通貫で整理します。IT担当者が短期間で初期成果を出し、現場定着に繋げるための実務ガイドです。

単なる機能比較ではなく、業務課題の定義からPoC設計、セキュリティ審査、運用・改善の回し方まで、社内説明資料や稟議にそのまま使えるレベルの具体性に落とし込みます。指標は測定可能なKPIで定義し、意思決定の迷いを減らします。

中小~中堅企業で多い「PoC止まり」「セキュリティ懸念で凍結」を避けるため、失敗事例と回避策も提示。自社のリスク許容度に合わせたガバナンス設計の雛形も掲載します。

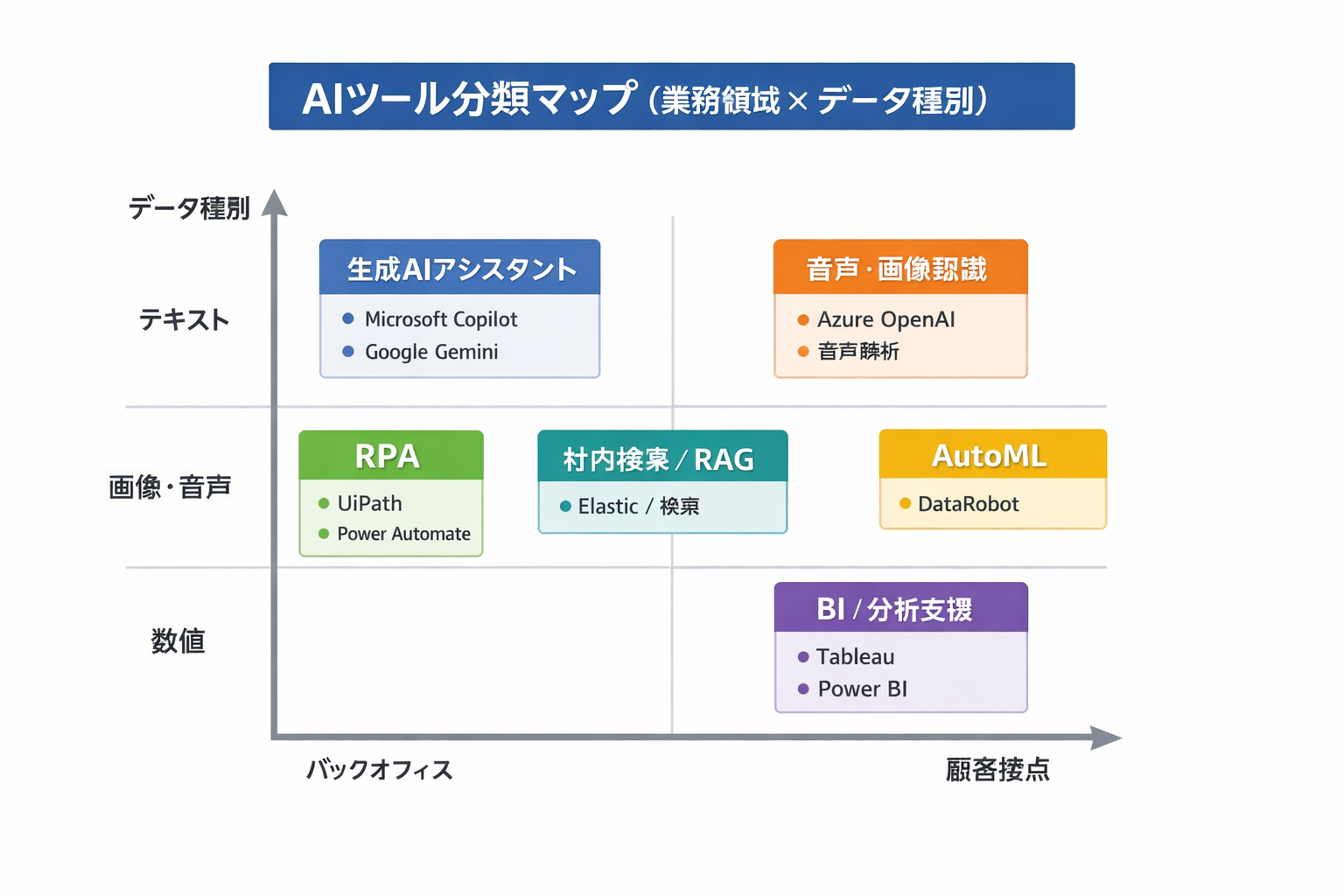

AIツールの全体像と主要カテゴリ

まずは自社の課題とデータ特性に合わせてカテゴリを絞り込みます。業務の性質(反復/判断/探索)とデータの種類(テキスト・数値・画像/音声)により、最適なツールが変わります。

- 生成AIアシスタント:文章作成、要約、翻訳、メール・議事録の下書き。例:Microsoft Copilot、Google Gemini、ChatGPT(企業版/Azure)。

- 業務自動化(RPA):定型操作の自動化。AIと組み合わせて非定型文書の前処理も可能。例:UiPath、Power Automate Desktop。

- 社内検索/RAG:社内文書を安全に検索・要約。権限連携と監査が鍵。例:Elastic/Enterprise Search、Azure AI Search。

- 自動機械学習(AutoML):需要予測やスコアリングを高速立ち上げ。例:DataRobot、Azure AutoML、Google Vertex AI。

- BI・分析支援:自然言語での可視化・探索。例:Power BI Copilot、Looker with Gemini。

- 音声・画像認識:コール解析、検査の自動化。例:Whisper系STT、Vision API、Edge推論。

用途別の比較と選定ポイント

選定では、短期の成果と中長期の拡張性を同時に評価します。加えて、データの所在と権限制御が自社のセキュリティ方針と整合するかを必ず確認します。

- 導入難易度:既存SaaS連携の容易さ、社内ID連携(SSO/SCIM)、権限モデルの適合度。

- ROI速度:セットアップに要する週数、初月からの工数削減見込み、現場の学習曲線。

- セキュリティ/所在:データ保持/学習利用の既定、データ越境の有無、テナント分離、監査ログ粒度。

- 拡張性:API/プラグインの有無、ワークフロー自動化の拡張、モデル切替可能性。

- ライセンス費用:ユーザー単価/実行単価、上限・バースト制御、PoC期間の無償/割引条件。

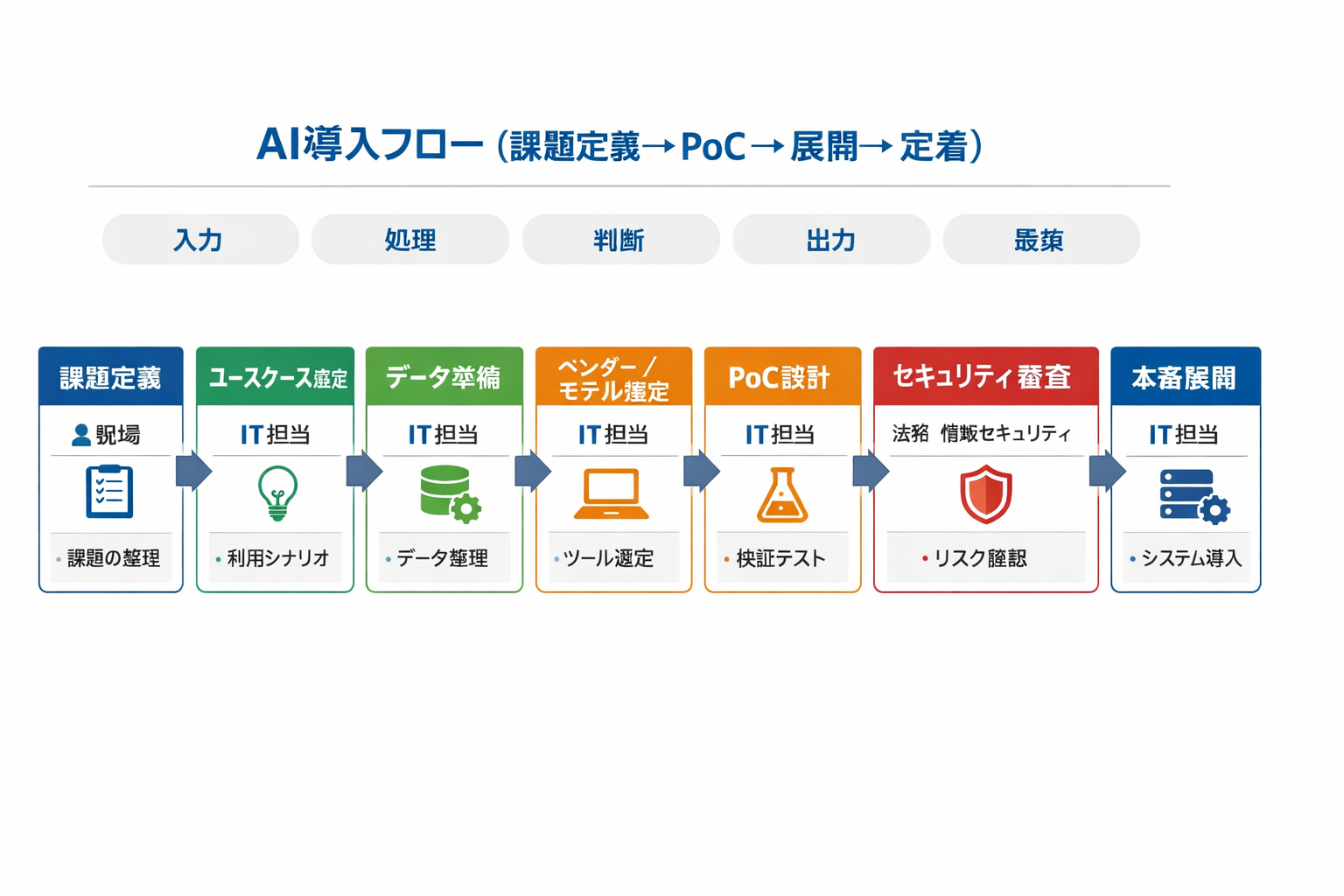

現場で機能するAI導入ステップ

PoC設計段階でKPIと退出条件(止める基準)を明文化すると、意思決定の速度が上がります。以下の手順は中堅企業での標準パターンです。

- 課題定義(現場主導):対象業務の現状KPI(処理件数/時間/エラー率)とボトルネックを数値で特定。成果指標候補を3つ以内に絞る。

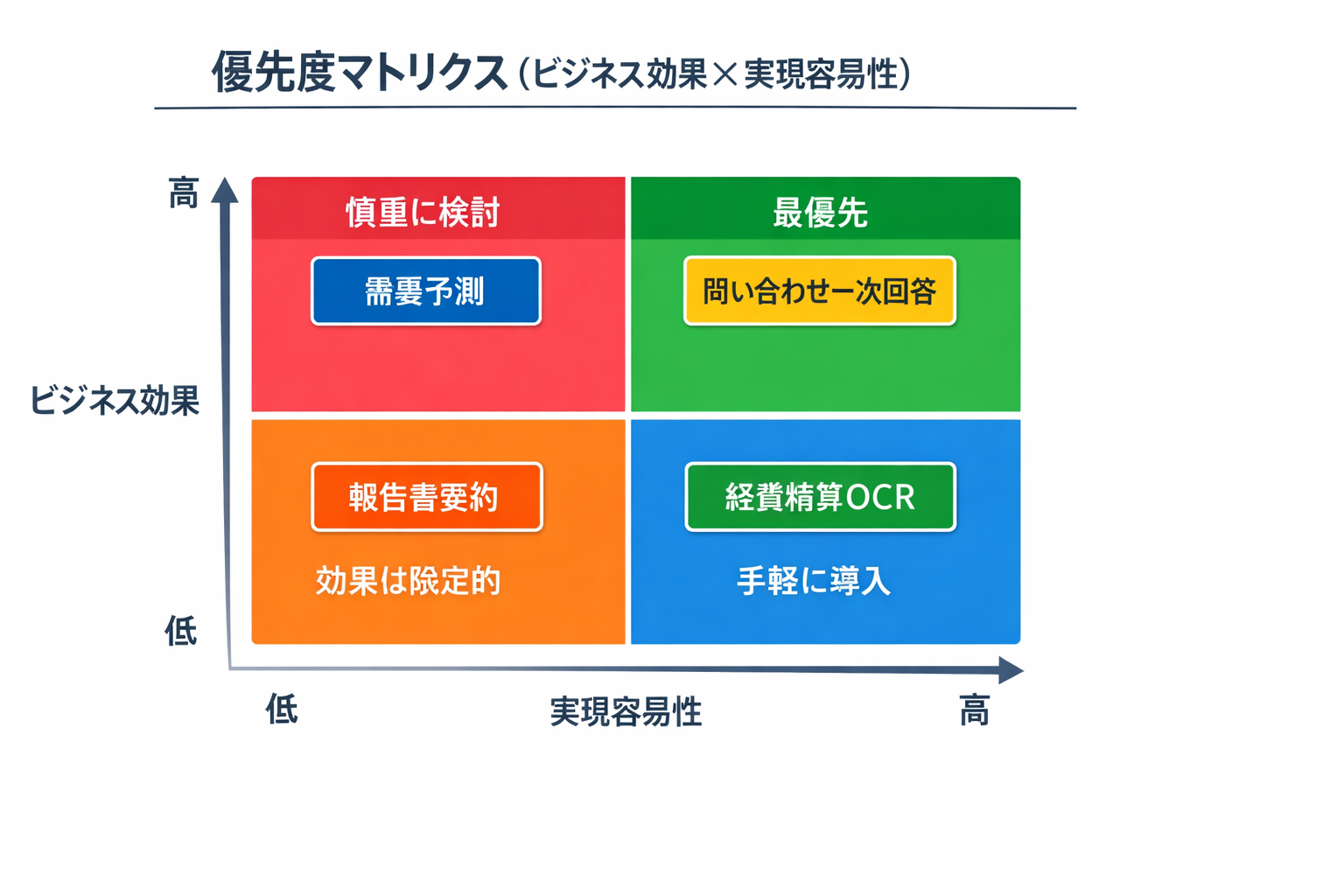

- ユースケース選定(IT/現場):難易度×効果の2×2で優先度付け。2週間以内に効果が見える短尺案件を1つ含める。

- データ準備(現場/データ担当):必要データの所在・権限を棚卸し。最低限の前処理(匿名化/正規化)と品質サンプル30〜50件を確保。

- ベンダ/モデル選定(IT/調達):SSO対応、監査ログ、データ保持ポリシーを必須条件に。価格は3パターン(最小/想定/上限)で試算。

- PoC設計(IT/現場/法務):目標KPI、測定方法、母数、期間、サンプル抽出法、成功/中止基準、リスク対応を1枚に集約。

- セキュリティ審査(情報セキュリティ/法務):データ分類、越境有無、DLP/暗号化、権限連携、契約(補償/著作権)をチェックリストで確認。

- 本番展開(IT):RBAC設定、監査ログ有効化、APIキー保護、レート制限、フェイルセーフ(手作業切替)の用意。

- 定着運用(現場/IT):週次レビューでプロンプト/ワークフローを微修正。KPI改善が鈍化したら次のユースケースへ展開。

判断基準とPoC評価指標(数値で決める)

PoCの成否は測定設計で8割決まります。指標は「業務KPI」「品質KPI」「運用KPI」の3系統で定義し、誤検知コストを金額換算します。

- ビジネスインパクト:処理時間△30%以上、工数削減100時間/月以上、売上貢献率など絶対額で評価。

- 実現可能性:データ入手性、権限・APIの有無、プロンプト/モデルで再現可能かを事前サンプルで確認。

- 法令・ガバナンス:個人情報/機密の扱い、データ越境、著作権/生成物の帰属、監査要件への適合。

- 運用性:モデル更新時の回帰試験、エスカレーション、SLA/サポート、可観測性(ログ/メトリクス)。

- 効率KPI:処理時間短縮率、1人当たり処理件数増加。例:問い合わせ1件あたり対応時間を7分→3分。

- 品質KPI:正確率/再現率、幻覚率<2%、一次回答解決率>40%、BLEU/CER等(必要時)。

- 運用KPI:安定稼働率>99.5%、エラーMTTR<30分、監査ログ欠損=0。

- コストKPI:実行単価、モデル呼び出し回数、学習/再学習コスト、クラウド出通信費。

- 安全KPI:PII流出インシデント=0、プロンプトインジェクション検知率>90%。

AIの失敗事例と実務対策

失敗はパターン化できます。下記の対策を事前に組み込むことで、凍結や後戻りを最小化できます。

- データ流出:企業テナント内推論、DLP、持ち出し制御、権限連携(RBAC)を必須化。ベンダの学習利用を明示的にオフ。

- PoC止まり:KPIと退出条件を事前合意(例:目標未達かつ補正コスト>削減額で中止)。展開計画(SSO/監査/権限)をPoC内で検証。

- 幻覚/精度劣化:RAGで根拠提示、禁止語/検証プロンプト、ヒューマンレビューを閾値連動。定期評価セットで回帰試験。

- 現場不採用:権限とワークフローを現場業務に合わせる。ショートカット/テンプレ配布と30分の操作研修を初回必須に。

- 隠れコスト増:レート制限とキャッシュ設計。高発話業務は月次上限を設定し、超過時は要承認フローに。

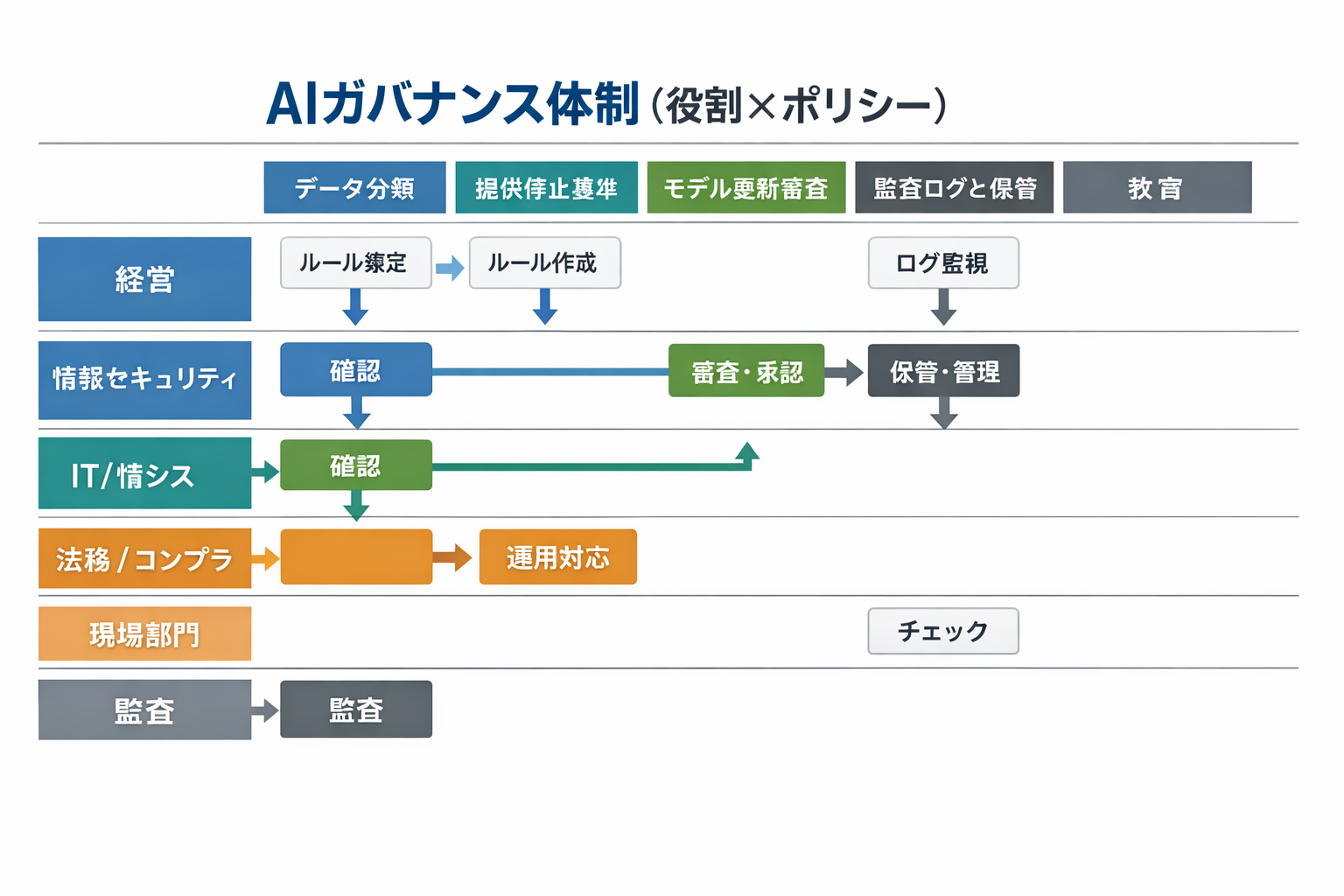

セキュリティ・ガバナンスと運用上の注意点

AIは導入後の運用でリスクが顕在化します。体制・規程・監査可能性をセットで整えましょう。契約/著作権条項も早期に確認します。

- データ分類:機密/社外秘/社内/公開の4分類。機密データは生成AI入力原則禁止、例外は承認制。

- 権限/監査:SSOとRBAC必須。監査ログは90日以上保管、検索/抽出可能に。個人操作は仮名化。

- モデル更新:更新時は回帰試験を自動実行。品質KPIの閾値未達ならロールバック。

- プロンプト安全:プロンプトインジェクション対策(出力制約、外部呼び出しの許可リスト、検証プロンプト)。

- 提供停止基準:幻覚率>5%またはPII検知時は自動停止→エスカレーション→是正後再開。

- 契約/著作権:生成物の権利帰属、補償、第三者権侵害時の対応、データ越境・準拠法を明記。

AI導入は「正しいユースケース選定」と「測定可能なKPI設計」、そして「運用ガバナンス」で成功確率が大きく変わります。本記事の比較軸とステップをそのまま社内計画に落とし込み、2週間で小さく始めて改善サイクルを回してください。

まずは1件、短尺で効果が見える案件(要約や一次回答)から。成功指標と退出条件を明文化し、セキュリティ審査と並走させることで、PoC止まりを回避できます。成果が出たら横展開し、データ基盤と運用体制を段階的に拡張しましょう。